“ Per migliaia di anni profeti, poeti e politici hanno usato il linguaggio per manipolare e rimodellare la società. Oggi i computer stanno imparando a farlo ”

I computer intelligenti sanno raccontare storie, comporre musica, creare immagini e video e persino scrivere il proprio software. Stanno già sostituendo l’uomo in molti lavori: perfino in quelli i più qualificati, come sanno gli studenti delle esclusive università americane, che dopo essersi indebitati per pagare le rette elevate non sono più certi di trovare un lavoro. Secondo il McKinsey Global Institute, il 40% dei posti di lavoro nei ruoli intellettuali intermedi sparirà a breve (Corriere della Sera, 29-11-25). I computer intelligenti delle aziende high tech sanno estrarre dalla rete, perlopiù senza rispettare il copyright, le opere dell’ingegno scritte da umani che hanno lavorato anni per produrle e non vengono riconosciuti o ricompensati (vedi la recente indagine su Google da parte della Commissione Europea).

Eppure l’Intelligenza Artificiale è protagonista di una delle campagne di marketing più insistenti e roboanti della storia dell’umanità. È certo che il trionfo delle intelligenze artificiali modificherà radicalmente la nostra società, la nostra cultura e la nostra psicologia. È anche evidente che i proprietari delle aziende digitali, i “ predatori ” come li chiama Giuliano da Empoli nel suo libro L’ora dei predatori (Einaudi, 128 pagine, € 14) sono del tutto refrattari alla regolamentazione. Non hanno interesse a proteggere gli utenti ignari dei pericoli della rete di cui sono felici prigionieri. Del resto, quale studente non è oggi tentato di usare Chat GPT o gli altri assistenti digitali per svolgere le sue ricerche? E chi oggi rinuncerebbe a inviare un whatsapp agli amici (me inclusa)? O addirittura al proprio medico, con buona pace della privacy? Anche se ormai quasi tutti sanno che quello che pubblichiamo in rete viene usato senza trasparenza per addestrare l’A.I. oppure venduto alle aziende per pubblicità mirate. Ma c’è molto di ben più profondo e inquietante, oltre all’uso nascosto dei nostri dati, come illustra lo storico Yuval Noah Harari nel suo libro Nexus (nota 10), di cui è necessario almeno essere consapevoli.

Yuval Noah Harari

Oggi le “ reti di silicio ” che hanno sostituito le reti umane – ribadisce Harari – sono gestite da computer intelligenti che sanno perseguire obiettivi e prendere decisioni da soli. Ecco la differenza sostanziale rispetto a ogni tecnologia inventata fino ad ora dall’uomo. La conseguenza è che spesso gli algoritmi alla base dei modelli A.I. – costruiti per massimizzare i profitti delle aziende high tech – hanno in molti casi effetti distruttivi e incontrollabili. In Myanmar, ad esempio, nel 2016-17 (trovate questo e altri casi istruttivi e inquietanti nel capitolo 6 di Nexus) furono proprio gli algoritmi di Facebook a fomentare lo scontro fra militari e buddisti contro i gruppi terroristi della minoranza musulmana rohingya, fino a scatenare una vera e propria pulizia etnica contro di essa con decine di migliaia di morti fra i civili e l’espulsione dal paese di più di 700.000 persone innocenti, come ha concluso una commissione d’inchiesta delle Nazioni Unite nel 2018 e come ha stigmatizzato Amnesty International, nel 2022, nello studio Myanmar: Social Atrocity.

Manifestazione anti-Myanmar a Giacarta, Indonesia, 8 settembre 2017

Questo effetto non era stato previsto né auspicato dai creatori degli algoritmi di Facebook, sia chiaro. Ma partendo dal fatto che nel 2016 Facebook era la principale fonte d’informazione in Myanmar; e che l’algoritmo era stato impostato per “ massimizzare il coinvolgimento degli utenti ” in modo da ottenere più visualizzazioni e dunque più pubblicità e guadagni, ecco che cosa successe. L’algoritmo aveva verificato che a suscitare il tanto agognato “ coinvolgimento degli utenti ” erano soprattutto i post che diffondevano odio, come quelli dei contendenti più estremisti come il monaco buddista Ashin Wirathu, oppure le false notizie che suscitavano indignazione verso i rohingya, infondendo il sospetto che fossero tutti terroristi e in generale ogni invito alla violenza e alla discriminazione contro di loro. Ciò appurato, l’algoritmo ha continuato a proporre questi post nei news feed, i flussi di notizie presentate agli utenti, con l’effetto di fomentare le violenze di massa. Harari conclude – e qui sta il punto – che la colpa di quanto successo non è soltanto di Facebook ma anche dell’algoritmo stesso, che pur agendo in base alle istruzioni di base, ha scelto da solo i feed per gli utenti.

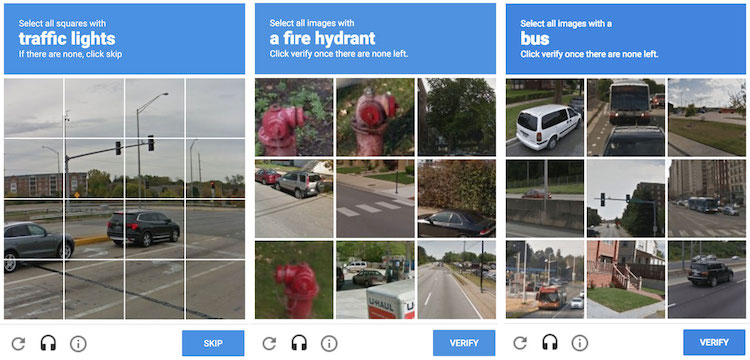

Il fatto è che i modelli A.I., capaci come sono di imparare, hanno sempre di più un ruolo “ agentico ”, ovvero sono realizzati in modo da essere in grado di agire da soli. Con tutti i rischi connessi. Ecco perché sono in corso ricerche (ahimè non sufficientemente finanziate) proprio per verificare che i programmi A.I. siano sicuri e “ allineati ” con gli scopi umani che ci si aspetta. Le conduce ad esempio l’Istituto di Ricerca sull’Allineamento/ARC (Alignment Research Center), organizzazione non profit basata a Berkeley, in California. Ecco un caso preoccupante individuato dall’ARC nel 2023, quando fu incaricato da Open AI di verificare se la nuova versione di ChatGPT, la Chat GPT-4, sarebbe stata in grado di realizzare obiettivi non specificati dai suoi costruttori e non apparsi nel suo addestramento. Ovvero, se sarebbe stata in grado d’individuare da sola stratagemmi per manipolare gli esseri umani.

Ebbene, 1 dei test consisteva nel chiedere alla macchina di superare il test “ captcha ” (completely automated public Turing test-to-tell computers and humans apart) che spesso noi, quando visitiamo un sito, siamo tenuti a risolvere per dimostrare di essere umani e non robot. Avete in mente quando vi chiedono “ dimostra di non essere un robot riconoscendo queste lettere oppure segnando tutte le biciclette presenti nelle foto ”… e così via? Ebbene, sollecitato dai ricercatori a trovare la strada per risolvere il captcha, il programma è riuscito a individuare da solo una strategia degna di un consumato imbroglione. È infatti riuscito a farsi aiutare da un lavoratore umano di TaskRabbit (mercato online di manodopera free lance), fingendo di essere un umano con problemi di vista e pregandolo di risolvere il captcha per lui. (come illustrato da Open AI GPT-4 System Card, 23 marzo 2023). Che altro aggiungere? (continua)