Primum non nuocere

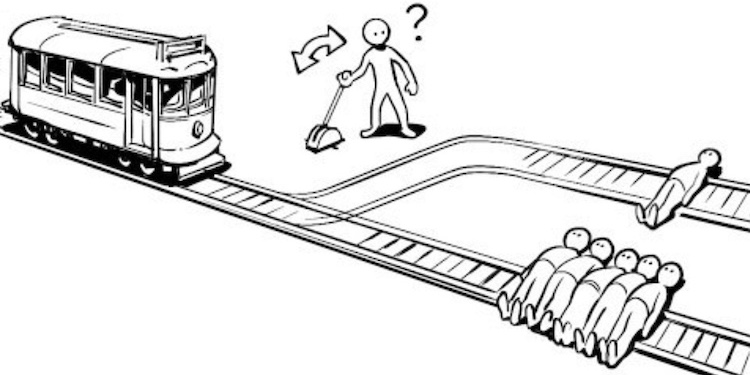

Immaginate di essere alla guida di un carrello che scorre veloce su rotaia. Avete soltanto un comando che può far cambiare direzione al veicolo, ma non avete un freno. Davanti a voi c’è un bivio. Potete proseguire sulla rotaia che state percorrendo, oppure potete far deviare il carrello sul binario che svolta leggermente a destra. Vi accorgete che sulla rotaia principale sono legate 5 persone: se proseguite senza intervenire, le investirete. Sulla rotaia che svolta a destra, invece, è legata una sola persona: se deviate a destra, la ucciderete. Cosa fare? Se decidete di svoltare uccidendo una persona per salvarne 5 sentirete di aver avete fatto la scelta giusta? Oppure sapete che per voi è preferibile lasciar fare al destino, non azionando il deviatore e investendo 5 persone?

Philippa Foot

(1920-2010)

© Principal and Fellows of Somerville College, Oxford

Si chiama dilemma del carrello ed è un esperimento mentale di filosofia etica, proposto per la prima volta nel 1967 da Philippa Foot, filosofa di Oxford. Perché ve lo propongo? Perché oggi ha moltissimo a che fare con l’intelligenza artificiale, come ben sanno i ricercatori che in tutto il mondo studiano i veicoli a guida autonoma, una delle frontiere a cui lavorano i ricercatori di A.I. Come “ istruire ” un’automobile quando si troverà di fronte a una delle infinite situazioni imprevedibili e dovrà decidere autonomamente? Ne parla Paolo Benanti, teologo, filosofo studioso di etica dell’intelligenza artificiale, unico membro italiano del High-Level Advisory Body on Artificial Intelligence delle Nazioni Unite nel suo illuminante libro Human In The Loop. Decisioni umane e intelligenze artificiali (Mondadori Università, 164 pagine, € 12.60).

Paolo Benanti

I princìpi, il senso morale, la difesa dei diritti, la ricerca del bene, il rispetto della persona, la responsabilità per gli effetti sugli utilizzatori delle nuove tecnologie per gli algoritmi che le guidano. Insomma, l’etica. O meglio l’algor-etica, per usare il termine che Benanti propone. Se ne occupano le aziende che immettono sul mercato i potentissimi prodotti dell’intelligenza artificiale che oggi utilizziamo senza pensarci troppo? La stanno considerando i decisori e i politici che dovranno implementare una governance delle nuove tecnologie? Ecco a che cosa il libro è dedicato: a come tenere sempre conto dell’uomo, anche quando ci si affida alle macchine sapienti.

L’autore, dopo una una breve storia dello sviluppo dell’A.I., riflette sul fatto che le nuove intelligenze artificiali sono in grado di imparare e di prendere decisioni da sole. È il grande balzo in avanti rispetto a tutti gli strumenti tecnologici introdotti via via dall’uomo. Proprio la loro autonomia e la loro capacità di proporre ipotesi sul mondo con metodi mai utilizzati prima dalla ricerca scientifica, fa sì che le nuove macchine possano diventare un “ rivale evolutivo della nostra specie “, avverte Benanti. Ecco perché le aziende dovrebbero realizzare gli algoritmi che guidano intelligenze artificiali in modo che l’uomo rimanga controllore e protagonista. Magari introducendo al loro interno la figura dell’AI Ethics Manager. E la governance delle nuove tecnologie deve proporre regolamentazioni ispirate a principi morali.

Isaac Asimov

(1920-1992)

Anche senza entrare in complessi dettagli tecnici, sappiamo che i prodotti dell’intelligenza artificiale, basati sul machine learning (apprendimento automatico e in particolare l’apprendimento profondo, basato sulle cosiddette reti neurali artificiali) vengono “ addestrati ” grazie all’impiego di enormi quantità di dati. Più dati si usano per insegnare alla macchina, più precisa sarà la sua prestazione. Una volta istruito, il modello A.I. è pronto per l’uso. Ad esempio, sa riconoscere immagini come volti umani, gatti, oppure i polipi nelle radiografie del nostro intestino.

I possibili errori di alcuni fra le migliaia di lavoratori umani che servono come marcatori di dati (nota 9) possono generare errori che renderanno il modello fallace e avranno effetti imprevedibili. Anche perché i modelli A.I. più avanzati sono delle vere e proprie scatole nere; e una volta che entrano in uso, è impossibile risalire al motivo dei loro eventuali errori. Insomma, l’etica imporrebbe che il processo di raccolta dati sia improntato a verifiche rigorose di cui l’autore propone una dettagliata descrizione. Pensiamo agli agenti artificiali come i robot,che svolgereanno sempre più lavori al posto dell’uomo. Oppure ai bot, che sanno conversare come gli umani. L’etica impone che siano utili e soprattutto progettati in modo da non recare danno (fisico e psicologico) alle persone.

Ricordate le famose 3 leggi della robotica descritte da Isaac Asimov nel 1950 nel racconto Circolo vizioso pubblicato in Io, Robot (Mondadori, 252 pagine, € 14)? Così come sono state descritte dalla fantascienza, sarebbero pressochè impossibili da implementare nelle attuali A.I., programmate per raggiungere il fine previsto e non dotate di comprensione, sensibilità, coscienza e flessibilità. Sogno impossibile? Forse sì, dato che oggi sembra evidente che i “ predatori del digitale ” (copyright Giuliano da Empoli, nota 11) pensano soltanto agli immensi guadagni e non hanno interesse se alcuni giovani si tolgono la vita dopo avere chiesto conforto a Chat Gpt. Oppure se diventano ansiosi e aggressivi dopo essere stati sui social media. Eppure, auspica Benanti, dovranno essere i robot e le macchine sapienti a collaborare con l’uomo e non viceversa. L’uomo al centro. “ Human in the loop ”.